| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- hadoop2

- RNN

- 하이브

- 하둡2

- collections

- yarn

- HelloWorld

- 알고리즘

- 그래프이론

- hive

- LSTM

- C언어

- 파이썬

- 코딩더매트릭스

- scrapy

- 선형대수

- effective python

- python

- GRU

- 딥러닝

- Java

- tensorflow

- codingthematrix

- 텐서플로

- recursion

- graph

- C

- NumPy

- 주식분석

- Sort

- Today

- Total

목록GRU (3)

EXCELSIOR

07-3. 순환 신경망 LSTM, GRU - (3)

07-3. 순환 신경망 LSTM, GRU - (3)

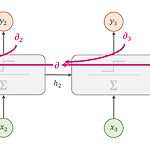

이번 포스팅은 핸즈온 머신러닝 교재, cs231n 강의를 가지고 공부한 것을 정리한 포스팅입니다. RNN에 대해 좀더 간략하게 알고 싶으신 분들은 아래의 링크를 참고하면 됩니다. 텐서플로 실습 위주 : [러닝 텐서플로]Chap06 - 텍스트2: word2vec, Bidirectional RNN, GRU, 임베딩 시각화LSTM & GRU의 간략한 설명 : RNN - LSTM(Long Short Term Memory networks) 07-3. 순환 신경망 LSTM, GRU - (3) 저번 포스팅인 07-2. 순환 신경망(RNN) - (2)에서는 RNN을 학습시키는 방법인 BPTT와 텐서플로를 이용해 MNIST 분류기와 시계열 데이터를 예측하는 RNN 모델을 구현해 보았다. 그리고 심층 RNN을 구현하는 방..

[러닝 텐서플로]Chap06 - 텍스트2: word2vec, Bidirectional RNN, GRU, 임베딩 시각화

[러닝 텐서플로]Chap06 - 텍스트2: word2vec, Bidirectional RNN, GRU, 임베딩 시각화

Chap06 - 텍스트 2: 단어 벡터, 고급 RNN, 임베딩 시각화5장에서 살펴본 텍스트 시퀀스를 좀 더 깊이 알아보며, word2vec이라는 비지도학습 방법을 사용하여 단어 벡터를 학습하는 방법과 텐서보드를 사용해서 임베딩을 시각화 하는 방법에 대해 알아보자. 그리고 RNN의 업그레이드 버전인 GRU에 대해서 알아보자. 6.1 단어 임베딩 소개5.3.2에서 텐서플로(TensorFlow)를 이용해 텍스트 시퀀스를 다루는 방법을 알아 보았다. 단어 ID를 저차원의 Dense vector로의 매핑을 통해 단어 벡터를 학습시켰다. 이러한 처리가 필요한 이유는 RNN의 입력으로 넣어 주기 위해서였다.TensorFlow is an open source software library for high perform..

RNN - LSTM(Long Short Term Memory networks)

RNN - LSTM(Long Short Term Memory networks)

이번 LSTM은 Chris송호연님의 블로그와 aikorea.org를 많이(실은 거의...) 참조하였으며, 이미지 출처는 원 저작자인 Colah.github.io 입니다. 문제가 될경우 삭제 하겠습니다..ㅜㅜ 1. LSTM 배경 - 장기 의존성(Long-Term Dependency) 문제점 RNN의 장점은 이전의 정보를 공유하여 활용할 수 있다는 것이다. 하지만, 시점간의 간격(Gap)이 크지 않을 경우에 가능하며 이러한 문제의 원인은 Vanishing Gradient에서 알 수 있듯이 BPTT에서 Chain Rule에 의해 [-1, 1]사이의 값들이 계속 곱해지다보니 앞쪽으로 갈 수록 그 값이 작아져, 결국에는 소멸해버려 Parameter들의 업데이트가 되지 않는 문제가 발생하기 때문이다. 이러한 문제를..